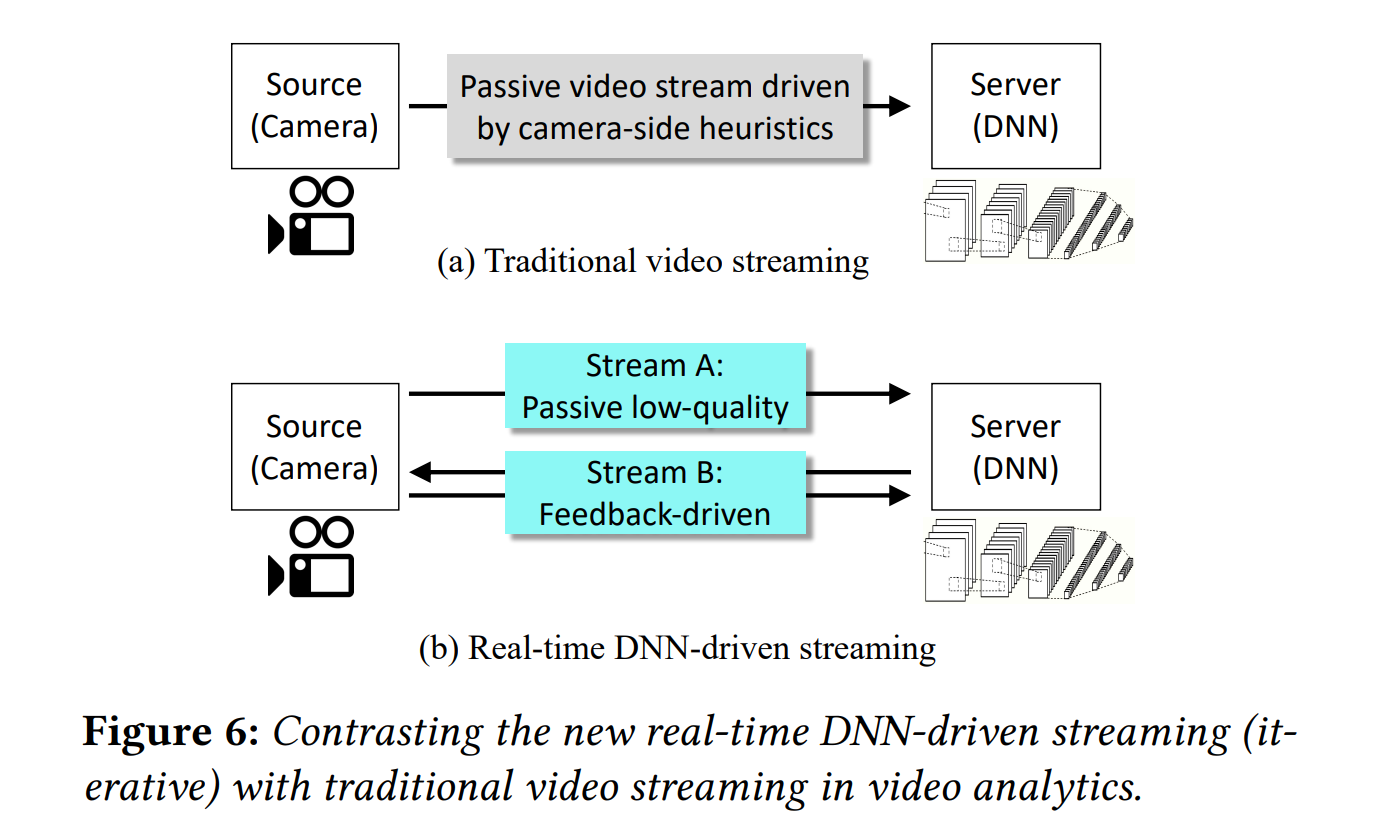

很多video analytics都是client端决定传输质量,为什么需要server driven?一个原因是client端不好估计视频传输质量对推理效果的影响,另一个原因是推理效果在server端可以很直观地给出,这对于视频的补充需求是一个context。另外有些工作也是server driven,但这些早期工作是直接调整视频的质量,但实际上不需要再传视频,只需要提高画质的那部分region就好了。这个分析我是比较认可的,会比其他基于超分或者client端heuristics的工作的上限和稳定性都更好。文章设置了很多人工参数和阈值去决定哪些是需要重传高画质的regions。

但这个工作因为需要多轮的resend,delay会超过1秒,如果可以实现0 resend可以降低很多延迟,而且准确率保持一致的话会是一个不错的创新,低延时的server端推理在自动驾驶等领域比较有价值。自然的想法是可不可以在edge端把ROI全部抠出来,然后只传ROI?是不行的,region proposals是由feature maps产生的,而feature maps有需要很多层卷积,在client端做不了。原始视频副本最终肯定会用某种方式保存回server,无论是传输还是人工回收,所以更应该考虑的是对大规模部署camera的信息分析的实时性,和适用的query种类的多样性。另外一篇几乎同时期的文章Video Analytics with Zero-streaming Cameras有这样的思想,之后会看一下。另外这篇文章的作者今年又发了一篇MLsys,从视频编码的角度入手:AccMPEG: Optimizing Video Encoding for Accurate Video Analytics。